【毕业设计】 基于深度学习的猫咪行为检测 算法

一、背景意义

猫咪行为检测是宠物管理和训练中重要的研究领域。准确识别猫咪的行为状态(如躺卧、坐着和站立)不仅有助于主人更好地理解和照顾宠物,还能为宠物健康管理提供数据支持。随着深度学习技术的发展,基于图像的行为检测方法逐渐成为主流,相比传统方法具有更高的准确性和实时性。因此,构建一个高效的猫咪行为检测系统具有重要的实际应用意义。

二、数据集

2.1数据采集

数据采集是制作猫咪行为检测数据集的第一步,目的是收集多样化的猫咪行为图像样本,以确保数据集的代表性和全面性。此过程的主要步骤包括:

实地拍摄:在不同环境中拍摄猫咪,记录其各类行为(如躺卧、坐着、站立)。拍摄应涵盖不同品种、年龄和性别的猫咪,以捕捉到多元化的行为样本。

不同状态与场景:在不同时间段和场景中进行拍摄,包括家庭环境、户外空间等,以确保数据集的多样性,并反映猫咪在不同环境下的行为表现。

使用专业设备:采用高分辨率相机进行拍摄,以确保图像清晰度足够高,能够清楚地展现猫咪的姿态和行为。这将有助于后续的标注和模型训练。

整理与存储:将收集到的图像按照行为类别进行分类存储,确保每个类别(躺卧、坐着、站立)有足够的样本,以便于后续的数据清洗和标注。

数据清洗的目标是提高数据集的质量,去除不符合标准的图像。清洗过程通常包括以下几个步骤:

去重:使用图像哈希算法或相似度检测工具,检查数据集中是否存在重复的图像,确保每张图像都是唯一的。

质量检查:对所有图像进行质量评估,剔除模糊、低分辨率或与主题不相关的图像。确保每个样本能够清晰展现猫咪的状态和行为特征。

格式标准化:将所有图像统一为同一格式(如JPEG或PNG)和尺寸(如640x480像素),以便于后续处理和深度学习模型的训练。

标注完整性检查:检查每个行为类别的数据样本数量,确保每个类别具有足够的图像样本,以避免模型训练过程中的偏差。

2.2数据标注

数据标注是制作猫咪行为检测数据集的重要步骤,主要目标是为每张图像中的猫咪行为添加标签。标注过程包括以下几个步骤:

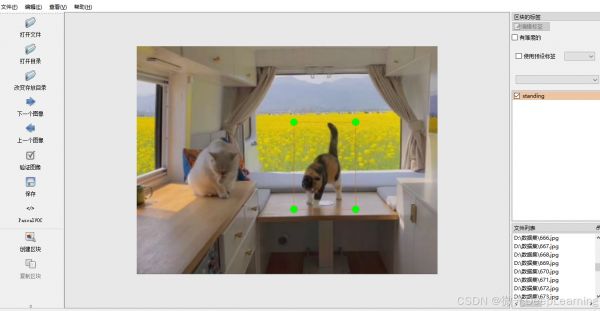

选择标注工具:选择适合的标注工具,如LabelImg,以便于对图像进行准确的标注。

绘制边界框:逐一打开图像,使用矩形工具为每个猫咪行为绘制边界框,并标注相应的行为状态,例如“躺卧”、“坐着”、“站立”。

确保类别一致性:为每个绘制的边界框选择正确的行为类别,并记录这些信息,确保与数据集中定义的类别一致,避免混淆。

保存标注数据:完成标注后,将标注结果保存为指定格式(如XML或TXT),以便于后续使用和模型训练。

标注质量审核:对标注结果进行复审,确保每个猫咪行为都已被准确标注,避免漏标或误标。必要时,可以邀请其他人员进行交叉验证,以提高标注的准确性。

使用LabelImg进行猫咪行为检测数据集的标注过程复杂且工作量较大。首先,启动LabelImg软件并选择目标图像文件夹,逐一打开每张图像,使用矩形工具为每个猫咪的行为绘制边界框,包括躺卧、坐着和站立。每绘制一个框后,标注人员需为其选择相应的行为类别,并记录该信息。标注完成后,需保存每张图像的标注结果,以确保数据的完整性和准确性。由于每张图像可能包含多个猫咪行为,标注人员需要保持高度的专注,避免漏标或误标。此外,标注过程中可能需要对图像进行多次调整和检查,因此这一过程不仅耗时耗力,还要求标注人员具备一定的专业知识,以确保数据集的标注质量符合训练需求。

猫咪行为图片数据集中包含以下几种类别:

躺卧:猫咪处于放松状态,通常躺在地面或其他表面上。坐着:猫咪直立姿态,通常保持警觉,准备随时行动。站立:猫咪站立状态,可能在观察周围环境或准备移动。2.3数据预处理

数据预处理是为模型训练做准备的重要步骤,主要包括以下几个方面:

数据增强:利用随机翻转、旋转、缩放、裁剪和颜色调整等方法对原始图像进行增强,增加数据集的多样性,提升模型的泛化能力。

归一化处理:对图像像素值进行归一化,将其缩放到[0, 1]或[-1, 1]的范围内,以加速模型训练的收敛速度。

划分数据集:将处理后的数据集划分为训练集、验证集和测试集,通常按照70%训练、20%验证、10%测试的比例进行分配,确保每个子集中的猫咪行为分布一致。

格式转换:将图像和标注数据转换为适合所用深度学习框架的格式,如YOLO模型需要生成对应的TXT文件,记录每张图像中的猫咪行为信息。

标注格式:

VOC格式 (XML)YOLO格式 (TXT)yolo_dataset/

│

├── train/

│ ├── images/

│ │ ├── image1.jpg

│ │ ├── image2.jpg

│ │ ├── ...

│ │

│ └── labels/

│ ├── image1.txt

│ ├── image2.txt

│ ├── ...

│

└── test...

└── valid...

voc_dataset/

│

├── train/

│ ├───├

│ │ ├── image1.xml

│ │ ├── image2.xml

│ │ ├── ...

│ │

│ └───├

│ ├── image1.jpg

│ ├── image2.jpg

│ ├── ...

│

└── test...

└── valid...

三、模型训练

3.1理论技术

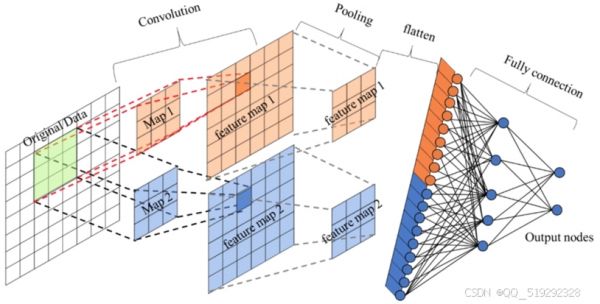

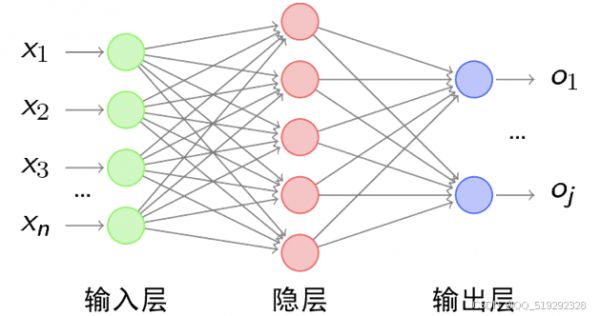

卷积神经网络(CNN)是一种深度学习模型,专为处理图像数据而设计。其结构通常包括多个卷积层、激活层、池化层和全连接层。卷积层的核心在于卷积操作,使用多个卷积核对输入图像进行局部感知,提取特征图。每个卷积核在图像上滑动,能够捕捉出图像中的边缘、角点等低层次特征。激活层通常使用非线性函数(如ReLU)对卷积输出进行处理,以增强模型的表达能力。池化层则通过对特征图进行下采样,减少数据维度,保留重要特征信息,降低计算复杂度。经过多层卷积和池化后,最终的特征图被输入到全连接层,进行特征整合和分类输出。

CNN在猫咪行为检测中的优势主要体现在其强大的特征提取能力以及对图像分类和检测的适应性。通过深层的卷积结构,CNN能够自动学习到猫咪在不同状态下的特征,如躺卧、坐着和站立,从而实现高效的分类。相较于传统特征提取方法,CNN能够更好地处理复杂的图像背景和多样的姿态变化。此外,CNN的参数共享机制显著减少了模型的复杂度,使得训练过程更加高效,降低了过拟合的风险。这些特性使得CNN成为猫咪行为检测任务的理想选择,尤其是在标注数据充足的情况下。

YOLO是一种先进的实时目标检测算法,因其速度和准确性受到广泛关注。YOLO的结构主要包括深度卷积神经网络和检测头。该算法将输入图像划分为SxS的网格,每个网格负责预测边界框及其对应的类别概率。YOLO的核心优势在于其单次前向传播过程,能够同时进行目标定位和分类,从而显著提高检测速度。每个网格不仅预测物体的类别,还输出多个边界框及其置信度分数,实现对多个目标的检测。YOLO通过多层卷积提取特征,并在最后的检测层生成边界框和类别概率,利用非极大值抑制算法过滤冗余框,以获得最终的检测结果。

YOLO在猫咪行为检测中的优势主要体现在实时性和高效性。由于YOLO的特点是通过单次神经网络前向传播实现目标检测,其处理速度非常快,适合于需要实时监控的场景。此算法能够同时识别多种行为模式(躺卧、坐着、站立),避免了传统方法中逐个处理的低效率。此外,YOLO在检测多个目标时表现尤为突出,能够快速准确地检测到同一画面中多个猫咪的行为状态。此特性使得YOLO在猫咪行为监测和智能宠物管理等应用场景中得到广泛应用,为实时监控提供了强有力的技术支持。

3.2模型训练

1. 数据集预处理

在实施YOLO项目之前,首先需要准备和划分数据集。数据集应包含不同状态的猫咪图像,以确保样本的多样性和代表性。可以通过拍摄或网络爬虫等方式收集样本。将数据集随机划分为训练集、验证集和测试集,通常推荐的比例为70%训练、20%验证、10%测试。以下是数据集划分的示例代码:

import os

import random

import shutil

# 定义数据集路径

dataset_path = 'path/to/cat_behavior_dataset'

images = os.listdir(dataset_path)

# 随机划分数据集

random.shuffle(images)

train_split = int(len(images) * 0.7)

val_split = int(len(images) * 0.9)

train_images = images[:train_split]

val_images = images[train_split:val_split]

test_images = images[val_split:]

# 创建新的目录以存放划分后的数据集

os.makedirs('train', exist_ok=True)

os.makedirs('val', exist_ok=True)

os.makedirs('test', exist_ok=True)

for image in train_images:

shutil.copy(os.path.join(dataset_path, image), 'train/')

for image in val_images:

shutil.copy(os.path.join(dataset_path, image), 'val/')

for image in test_images:

shutil.copy(os.path.join(dataset_path, image), 'test/')

数据标注

数据标注是YOLO项目中的关键环节,准确标注直接影响模型的训练效果。使用LabelImg等标注工具为每张图像中的猫咪行为进行标注,通常采用矩形框的方式。为每个框选择相应的行为状态,并记录位置信息。以下是标注过程的简要步骤:

启动LabelImg,选择需要标注的图像文件夹。逐一打开图像,使用矩形工具绘制边界框。输入行为状态名称(如“躺卧”、“坐着”、“站立”等)并保存标注。确保每个行为状态均被标注,避免遗漏。2. 模型训练

在完成数据准备后,需要配置YOLO模型。首先,准备模型的配置文件,设置网络参数、学习率和批量大小等。创建数据描述文件(如data.yaml),指定训练和验证数据集路径及类别数。例如,data.yaml文件内容如下:

train: train

val: val

nc: 3 # 目标类别数量(躺卧、坐着、站立)

names: ['lying', 'sitting', 'standing']

模型配置完成后,可以开始训练YOLO模型。使用命令行运行YOLO训练命令,模型将开始处理训练数据。训练过程中监控损失值和准确率,以确保模型逐步收敛。以下是训练的示例命令:

python train.py --img 640 --batch 16 --epochs 50 --data data.yaml --weights yolov3.weights

在训练过程中,可以根据需要调整学习率和其他超参数。在hyp.scratch.yaml文件中,可以自定义学习率、动量、权重衰减等超参数:

# hyperparameters

lr0: 0.01 # 初始学习率

lrf: 0.1 # 最终学习率

momentum: 0.937 # 动量

weight_decay: 0.0005 # 权重衰减

3. 模型评估

完成训练后,对模型进行测试和评估是检验其性能的关键步骤。使用测试集中的图像,利用训练好的YOLO模型进行目标检测,生成检测结果并进行可视化。可以使用OpenCV对检测结果进行绘制,显示边界框和类别标签。以下是测试和可视化的示例代码:

import cv2

import torch

model = torch.hub.load('ultralytics/yolov5', 'custom', path='runs/train/exp/weights/best.pt')

img = 'test/test_image.jpg'

results = model(img)

results.show()

results.save('output/')

通过计算准确率、召回率和F1分数等评估指标,全面了解模型的性能,为后续的优化和调整提供依据。

四、总结

通过自制数据集和深度学习算法构建一个高效的猫咪行为检测系统。首先,通过精细的图像采集和标注,为模型训练提供丰富的样本支持。结合卷积神经网络(CNN)和YOLO算法,构建了改进的CNN-YOLO模型,以提升猫咪行为状态的检测准确性和速度。在各个阶段的实施中,通过合理的数据预处理和模型评估,验证了所构建模型的有效性,为智能宠物管理的发展提供了可靠的技术保障。

相关知识

【毕业设计】 基于深度学习的猫咪行为检测 算法

毕业设计:基于深度学习的野生动物种类识别系统 目标检测 人工智能

毕业设计:基于深度学习的遛狗牵绳检测系统 人工智能 python

毕业设计选题:基于深度学习狗狗品种识别系统 人工智能 机器学习 python 目标检测

行为检测论文笔记【综述】基于深度学习的行为检测方法综述

【计算机科学】【2019.03】基于深度学习的动物识别

2025年大数据 深度学习毕业设计项目选题集合

【毕业设计】基于深度学习的水族馆生物识别 人工智能 深度学习 目标检测 Python

毕业设计:基于深度学习的宠物狗种类识别 人工智能 YOLO

毕业设计:基于深度学习的动物叫声识别系统

原文链接: 【毕业设计】 基于深度学习的猫咪行为检测 算法 https://www.mcbbbk.com/newsview1331372.html

| 上一篇: 宠智灵猫大模型解决方案:生成式A... | 下一篇: 你知道你的宠物在想什么吗?揭秘它... |

推荐分享

- 1养玉米蛇的危害 28998

- 2狗交配为什么会锁住?从狗狗生... 7406

- 3我的狗老公李淑敏33——如何... 6433

- 4豆柴犬为什么不建议养?可爱的... 4770

- 5南京宠物粮食薄荷饼宠物食品包... 4714

- 6中国境内禁养的十大鸟种,你知... 4687

- 7自制狗狗辅食:棉花面纱犬的美... 4432

- 8家养水獭多少钱一只正常 4360

- 9湖南隆飞尔动物药业有限公司宠... 4316

- 10广州哪里卖宠物猫狗的选择性多... 4268